A/B-тесты в App Store и Google Play: практическое руководство

А/В тесты – это наш способ принимать взвешенные решения в мире, где каждая деталь имеет значение для успеха приложений. Пока одни команды месяцами спорят о том, какой скриншот лучше передает суть продукта, другие уже получают точные ответы от самой важной инстанции — своих пользователей. A/B-тестирование в ASO превращает наши догадки и интуицию в надежные данные.

В условиях, когда конкуренция достигает пика, а алгоритмы магазинов становятся все более автономными, роль экспериментов становится невероятно важной. К счастью, нам не нужно изобретать велосипед — инструменты для тестирования уже встроены в Google Play Console и App Store Connect, ожидая, когда мы начнем ими пользоваться. С помощью этих инструментов мы можем наладить прямой диалог с аудиторией: спрашивать и получать честные ответы в режиме реального времени и меняться к лучшему.

Давайте разберемся, что такое a/b тестирование и как превратить эти инструменты в нашего главного союзника в борьбе за конверсию и узнаваемость.

Что такое A/B-тестирование

A/B-тестирование это не просто сравнение двух картинок. Это наш способ вести осознанный диалог с аудиторией, где пользователи голосуют установками и действиями. По сути, мы задаем им вопрос: «Какой вариант страницы помогает вам быстрее понять ценность нашего приложения?» — и получаем точный, измеримый ответ.

Существует несколько форматов этого диалога. Сплит-тест — это фундаментальный подход, где мы проверяем одну конкретную гипотезу, например, сравниваем иконку А с иконкой Б, чтобы понять, какая из них привлекает больше внимания. Мультивариативный тест позволяет оценивать комбинации элементов — мы можем тестировать одновременно разные варианты скриншотов, описаний и видеопревью, чтобы найти оптимальное сочетание. Эксперимент со страницей продукта — это уже полноценный редизайн, где мы создаем альтернативную версию страницы и проверяем, насколько она эффективнее оригинала.

Но какие элементы стоит тестировать в 2025 году? Самые эффективные — те, что формируют первое впечатление:

- Иконка и первые 3 скриншота — визуальные акценты, которые цепляют взгляд в магазине

- Видео-превью — 15 секунд, которые могут показать ценность лучше длинных описаний

- Краткое описание - его видит пользователь на странице приложения

- Визуальная последовательность — логика построения страницы, которая ведет пользователя от первого впечатления к установке: первый экран как введение, цветовые акценты как ориентиры, призывы к действию, как финальный шаг.

Именно эти элементы пользователь видит в первые секунды знакомства с нашим приложением — и именно их нужно тестировать в первую очередь.

Зачем это нужно и кому подходит

A/B-тестирование выходит за рамки простого сравнения вариантов — оно становится системой координат для всего процесса оптимизации. Давайте разберемся, какую практическую пользу приносят тесты разным специалистам и в каких ситуациях они наиболее критичны.

- Маркетологи получают проверенные креативы для рекламных кампаний и могут переносить успешные решения в другие каналы привлечения.

- ASO-специалисты на основе данных точечно улучшают метаданные, последовательно повышая конверсию страницы.

- Разработчики видят, какие функции и интерфейсные решения действительно ценятся пользователями на этапе первого знакомства.

- UA-команды используют winning-варианты для увеличения ROI (Return On Investment), масштабируя успешные подходы.

A\B тесты особенно важны в ключевые моменты жизненного цикла приложения:

- Первый релиз — чтобы с самого начала выбрать оптимальную стратегию представления продукта

- Падение конверсии на 15%+ — как сигнал для немедленного поиска и тестирования решений

- Перезапуск приложения — когда нужно проверить новую концепцию позиционирования

- Выход на новые рынки — для культурной адаптации контента под локальную аудиторию

Особенно критично тестировать перед крупными обновлениями — это наша страховка от дорогостоящих ошибок. Каждый успешный эксперимент не только улучшает метрики, но и создает базу знаний о предпочтениях нашей аудитории.

Подготовка и планирование A/B-теста

Любой успешный эксперимент начинается с тщательной подготовки. Прежде чем запускать тест, нам нужно четко понимать: что мы проверяем, зачем и как будем оценивать результат.

Основой любого ab теста становится гипотеза. Она должна описывать не только изменение, но и ожидаемый эффект. Например: «Если изменить цвет иконки с синего на оранжевый, то CTR страницы увеличится на 10% благодаря лучшей заметности в выдаче».

Ключевое правило — тестируем один элемент за раз. Если мы одновременно меняем иконку, скриншоты и описание, мы никогда не поймем, какое именно изменение повлияло на результат. Двигаемся шаг за шагом — от самого важного к второстепенному.

Учет внешних факторов не менее важен. Период теста должен включать и будни, и выходные — чтобы избежать искажений из-за разного пользовательского поведения. Стараемся не запускать тесты во время крупных праздников или рекламных кампаний, которые могут искусственно изменить трафик.

Правильно спланированный тест — это уже половина успеха. Он позволяет нам не просто собирать данные, а получать actionable insights для дальнейших улучшений.

Процесс A/B-тестирования в Google Play

В Google Play Console для нас доступен мощный инструмент — Store Listing Experiments, который становится настоящей лабораторией для изучения предпочтений нашей аудитории. Здесь мы можем тестировать практически все элементы страницы: скриншоты, видео, описания и графику. Единственное важное ограничение — названия приложений нельзя проверять через этот инструмент, для этого потребуется полноценное обновление приложения.

Чтобы начать тестирование, нужно зайти в Google Play Console, выбрать нужное приложение и в левом меню найти раздел "Growth" / "Store listing experiments". Именно здесь создаются все A/B-тесты для Google Play, а именно:

- эксперимент с графическими объектами по умолчанию

Используем эксперимент этого типа для тестирования графических объектов, которые затрагивают часть от всех посетителей страницы приложения.

- эксперимент с локализованной версией

С помощью эксперимента с локализованной версией можно тестировать графические объекты и описания с участием тех пользователей, которые просматривают страницу приложения на определенном языке. Сначала добавляем переводы на нужные языки для элементов страницы приложения. После мы сможем запустить одновременно до пяти экспериментов с локализованными версиями.

- эксперимент с ценами

Эксперименты с ценами позволяют проводить тестирование и уверенно и точно корректировать цены в приложении в соответствии с покупательной способностью на разных рынках. Устанавливая для каждой страны свои цены на товары в приложениях и играх, можно привлечь клиентов с ограниченным бюджетом.

Система позволяет одновременно запускать до 3 различных вариантов страницы, что особенно ценно при работе с разными локализациями. Мы можем создавать отдельные эксперименты для разных регионов, адаптируя контент под культурные особенности каждой аудитории. Процесс тестирования требует времени. Обычно тест длится 7–14 дней, но формально Google Play не ограничивает минимальную длительность — тест завершается, когда достигается статистическая значимость.

Главное преимущество этого подхода — мы получаем четкие, измеримые результаты о том, какой контент действительно резонирует нашей аудитории. Система автоматически распределяет трафик между вариантами и показывает уровень статистической значимости, помогая принимать обоснованные решения о том, как улучшить нашу страницу в Google Play.

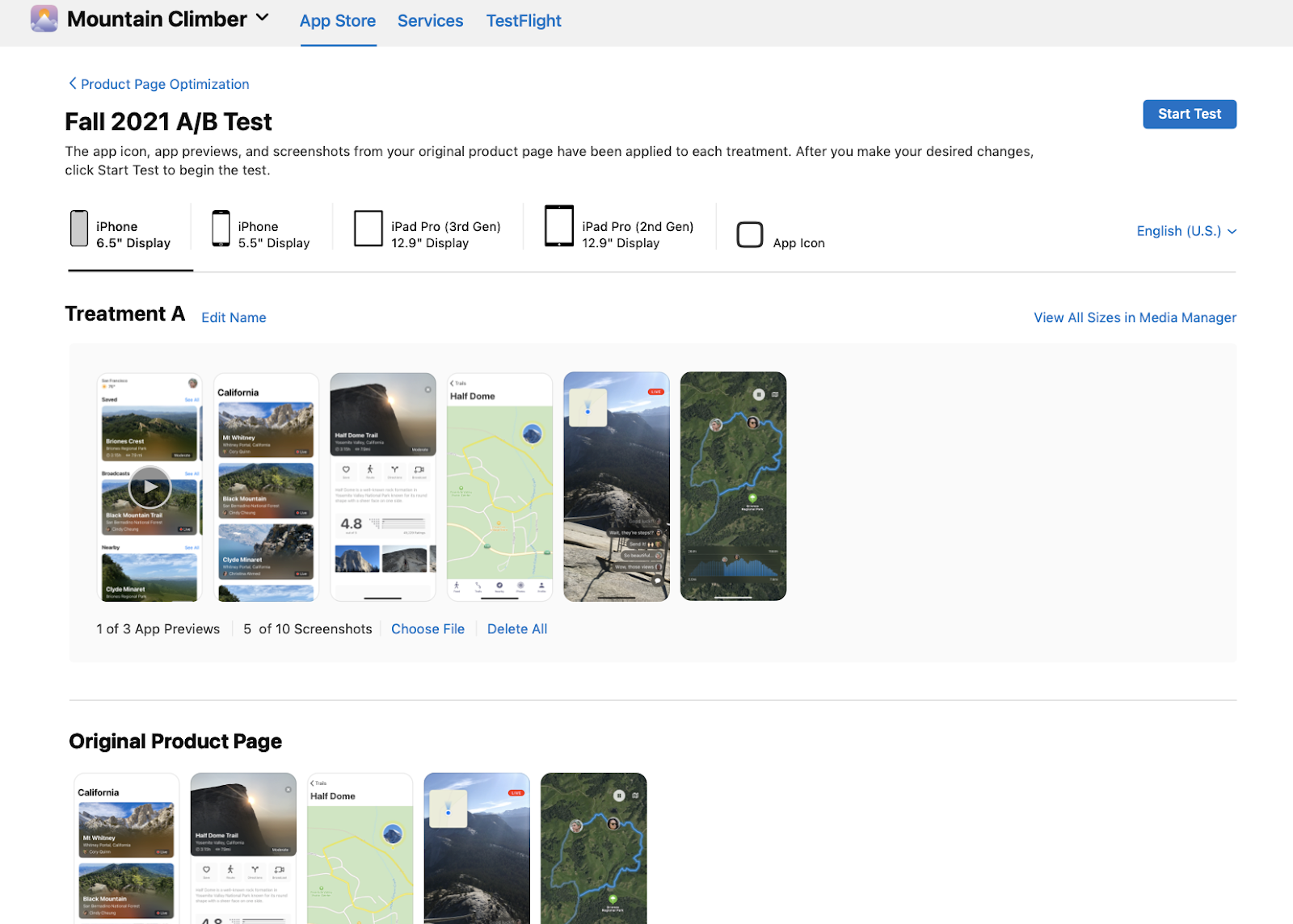

Процесс A/B-тестирования в App Store

В App Store Connect для оптимизации страницы приложения нам доступен инструмент Product Page Optimization (PPO). Чтобы начать работу, необходимо зайти в App Store Connect, выбрать приложение и перейти в раздел "Функции" (Features) / "Оптимизация страницы приложения" (Product Page Optimization).

Особенность Apple заключается в требовании обязательного ревью для каждого варианта страницы — процесс занимает около 2-3 дней. Мы можем тестировать до 3 альтернативных вариантов одновременно с оригинальной страницей, что позволяет сравнивать разные подходы к подаче контента.

Период тестирования может достигать 90 дней, что дает достаточно времени для сбора статистически значимых данных даже при умеренном трафике. Однако важно учитывать ограничения по локализациям — тесты нужно настраивать отдельно для разных языковых версий.

После запуска теста система автоматически распределяет пользователей между вариантами и предоставляет детальную аналитику по конверсии каждого из них. Это позволяет нам точно определить, какой дизайн и контент лучше всего находит отклик у аудитории App Store, прежде чем применять изменения ко всей странице приложения.

| Элементы A/B-теста | App Store | Google Play |

| Название приложения | Нет | Нет |

Иконка приложения | Да | Да |

| Скриншоты | Да | Да |

| Видео превью | Да | Да |

| Подзаголовок (Subtitle) | Нет | — |

| Краткое описание | — | Да |

| Полное описание | Нет | Да |

| Количество вариаций | До 3 | До 3 |

| Аудитория | Случайный сегмент органических пользователей | Случайный сегмент из всех посещающих страницу пользователей |

| Длительность теста | До 90 дней | Рекомендованный минимум 7 дней |

| Проходит ревью | Да | Да |

| Локализация | Да | Да |

Анализ и интерпретация результатов

Когда тест завершен, начинается самый важный этап — анализ данных. Статистически значимый результат (обычно при уровне доверия 95% и выше) говорит нам: разница между вариантами не случайна, и мы можем доверять полученным данным.

Ключевые метрики, на которые мы смотрим:

- Конверсия — сколько пользователей установили приложение после просмотра страницы

- CTR — сколько людей перешли на страницу приложения из поисковой выдачи

- Удержание — как долго пользователи остаются с приложением после установки

Даже «провальные» варианты могут дать ценные инсайты. Если вариант Б показал худшую конверсию, но лучшее удержание — это сигнал о том, что он привлекает более качественную, хоть и меньшую аудиторию. Каждый результат добавляет новые штрихи к портрету нашего пользователя.

После завершения теста мы:

- Внедряем победивший вариант как основной

- Фиксируем гипотезу и результаты в нашей базе знаний

- На основе полученных инсайтов формируем новые гипотезы для следующих тестов

Ab тестирование пример циклического процесса: тест, анализ, внедрение, новый тест — превращает нашу ASO-стратегию в постоянно совершенствующуюся систему и приближает наше приложение к идеальному соответствию ожиданиям пользователей, создавая прочную основу для долгосрочного роста.

Основные ошибки при A/B-тестах

Даже самый продуманный эксперимент может оказаться бесполезным, если мы совершаем типичные ошибки. Эти ловушки подстерегают как новичков, так и опытных специалистов, и цена им — потраченное время и неверные выводы.

- Преждевременное завершение — одна из самых частых ошибок в A/B-тестах. Важно понимать, что фиксированный срок тестирования (например, 7–14 дней) сам по себе не гарантирует качества данных. Ключевым критерием является достижение статистической значимости и достаточной выборки. Если приложение получает большой объем трафика, тест может дать надtжный результат уже через несколько дней. И наоборот — даже две недели не помогут, если выборка слишком мала. Поэтому вместо ориентации на срок теста нужно опираться на метрики значимости, стабильность результатов и использовать специальные калькуляторы статистической мощности.

- Дисбаланс трафика между вариантами искажает результаты. Когда один вариант получает больше пользователей в определенные дни или часы, мы теряем чистоту эксперимента. Система автоматического распределения трафика — наш лучший союзник в этом вопросе.

- Внешние вмешательства — проведение теста параллельно с рекламной кампанией или во время праздников — сравнимо с измерением температуры во время пожара. Мы получаем данные, но они ничего не говорят о реальной эффективности наших изменений.

- Межплатформенные переносы — опасная иллюзия, что успешный вариант в App Store будет так же работать в Google Play. Аудитории разных платформ имеют различные паттерны поведения, и то, что резонирует с одними, может не найти отклика у других.

Избегая этих ошибок, мы получаем чистые данные, на которые можно опереться при принятии таких важных для нашего приложения решений.

Практические советы и инструменты

Чтобы наши тесты приносили максимальную пользу, важно правильно расставлять приоритеты. Матрица «влияние/затраты» помогает нам фокусироваться на том, что действительно важно. В правый верхний угол попадают тесты с высоким потенциалом роста и минимальными усилиями для реализации — например, изменение первого скриншота или цвета иконки. Именно с них и стоит начинать.

Чеклист подготовки A/B-теста:

- Сформулировали четкую гипотезу и определили метрику успеха

- Выбрали один элемент для тестирования (принцип одного изменения)

- Проверили технические требования платформы (App Store/Google Play)

- Настроили корректное распределение трафика между вариантами

- Учли в расписании теста будни и выходные

- Исключили периоды праздников и рекламных кампаний

- Определили минимальный срок теста

- Подготовили систему для фиксации результатов и инсайтов

Автоматизация анализа через Firebase и другие аналитические системы экономит нам часы рутинной работы. Эти инструменты помогают выявлять закономерности: например, как изменения на странице приложения влияют на долгосрочное удержание пользователей. Настройка автоматических отчетов позволяет отслеживать прогресс без постоянного ручного вмешательства.

Визуальная локализация требует большего, чем просто перевод текстов. Цвета, жесты, символы — все это по-разному воспринимается в различных культурах. Например, то, что работает в Европе, может не найти отклика в Азии. Тестируя разные визуальные подходы для каждого региона, мы создаем персонализированный опыт для пользователей по всему миру.

Со временем эти практики становятся естественной частью нашего рабочего процесса, позволяя проводить тесты быстрее, а результаты — точнее.

Заключение

A/B-тестирование — это не разовая акция, а постоянный диалог с нашей аудиторией. Как живой организм, наша страница в магазинах приложений должна постоянно развиваться и адаптироваться к меняющимся предпочтениям пользователей.

Самая ценная особенность этого подхода — возможность последовательных улучшений. Каждый завершенный тест становится фундаментом для следующего эксперимента, создавая кумулятивный эффект. Даже небольшие, но регулярные оптимизации со временем дают впечатляющий результат.

Не менее важно тщательно документировать каждый эксперимент — от первоначальной гипотезы до финальных выводов. Эта база знаний становится нашим корпоративным наследием, позволяя новым членам команды понимать логику принятых решений и избегать повторения ошибок.

Мы не просто следуем трендам — мы создаем данные, которые помогают принимать взвешенные решения и уверенно двигаться вперед в конкурентной борьбе за внимание пользователей.

Тестируйте и достигайте успеха💙

Нет.

В App Store такие элементы не участвуют в A/B-тестах и меняются только через обновление приложения.

В Google Play название также нельзя тестировать — его можно изменить только при выпуске новой версии.

Наибольшее влияние обычно оказывают иконка, первые 2–3 скриншота и видео-превью. Эти элементы формируют первое впечатление, поэтому именно их стоит тестировать в первую очередь.

В Google Play тест длится до достижения статистической значимости (обычно 7–14 дней, но зависит от трафика).

В App Store PPO тест может длиться до 90 дней, но важно учитывать выходные, будни и стабильность трафика.

Нельзя.

Пользовательское поведение в сторах сильно отличается. То, что работает в Google Play, может не сработать в App Store, и наоборот. Каждый стор требует отдельной проверки гипотез.