A/B-тести в App Store і Google Play: практичний посібник

A/B тести — це наш спосіб ухвалювати зважені рішення у світі, де кожна деталь має значення для успіху додатків. Поки одні команди місяцями сперечаються, який скриншот краще передає суть продукту, інші вже отримують точні відповіді від найважливішого джерела — своїх користувачів. A/B-тестування в ASO перетворює наші здогадки та інтуїцію на надійні дані.

У ситуації, коли конкуренція досягає піку, а алгоритми магазинів стають все більш автономними, роль експериментів зростає неймовірно. На щастя, нам не потрібно вигадувати велосипед — інструменти для тестування вже вбудовані в Google Play Console і App Store Connect та тільки й чекають, коли ми почнемо їх використовувати. За допомогою цих інструментів ми можемо налагодити прямий діалог з аудиторією: ставити питання, отримувати чесні відповіді в режимі реального часу і ставати кращими.

Давайте розберемося, що таке A/B-тестування і як перетворити ці інструменти на наш головний союзник у боротьбі за конверсію та впізнаваність.

Що таке A/B-тестування

A/B-тестування — це не просто порівняння двох картинок. Це наш спосіб вести усвідомлений діалог із аудиторією, де користувачі голосують установками та діями. По суті, ми ставимо їм питання: «Який варіант сторінки допомагає вам швидше зрозуміти цінність нашого додатка?» — і отримуємо точну, вимірювану відповідь.

Існує кілька форматів такого діалогу. Спліт-тест — це фундаментальний підхід, коли ми перевіряємо одну конкретну гіпотезу, наприклад, порівнюємо іконку А з іконкою Б, щоб зрозуміти, яка привертає більше уваги. Мультиваріативний тест дозволяє оцінювати комбінації елементів — ми можемо одночасно тестувати різні варіанти скриншотів, описів і відеопрев’ю, щоб знайти оптимальне поєднання. Експеримент зі сторінкою продукту — це вже повноцінний редизайн, де створюється альтернативна версія сторінки та перевіряється її ефективність порівняно з оригіналом.

Що ж тестувати у 2025 році? Найефективніші елементи — ті, що формують перше враження:

- Іконка та перші 3 скриншоти — візуальні акценти, які одразу впадають в око

- Відеопрев’ю — 15 секунд, що можуть краще пояснити цінність додатка, ніж довгі описи

- Короткий опис — те, що бачить користувач на сторінці додатка

- Візуальна послідовність — логіка побудови сторінки, яка веде користувача від першого враження до встановлення: перший екран як введення, кольорові акценти як орієнтири, заклики до дії як фінальний крок.

Саме ці елементи користувач бачить у перші секунди знайомства з нашим додатком — і саме їх потрібно тестувати в першу чергу.

Навіщо це потрібно і кому підходить

A/B-тестування виходить за межі простого порівняння варіантів — воно стає системою координат для всього процесу оптимізації. Розглянемо, яку практичну користь тести приносять різним фахівцям та коли вони найбільш критичні.

- Маркетологи отримують перевірені креативи для рекламних кампаній та можуть переносити успішні рішення в інші канали залучення.

- ASO-фахівці на основі даних точково покращують метадані, поступово підвищуючи конверсію сторінки.

- Розробники бачать, які функції та інтерфейсні рішення справді важливі для користувачів на етапі першого знайомства.

- UA-команди використовують winning-варіанти для підвищення ROI, масштабуючи успішні підходи.

A/B тести особливо важливі в ключові моменти життєвого циклу додатка:

- Перший реліз — щоб одразу вибрати оптимальну стратегію презентації продукту

- Падіння конверсії на 15%+ — сигнал до негайного пошуку рішень

- Перезапуск додатка — щоб перевірити нову концепцію позиціонування

- Вихід на нові ринки — адаптація контенту для локальної аудиторії

Особливо критично тестувати перед великими оновленнями — це наша страховка від дорогих помилок. Кожен успішний експеримент не лише покращує метрики, але й формує базу знань про вподобання нашої аудиторії.

Підготовка та планування A/B-тесту

Будь-який успішний експеримент починається з ретельної підготовки. Перед тим як запускати тест, потрібно чітко розуміти: що ми перевіряємо, навіщо і як будемо оцінювати результат.

Основою будь-якого тесту є гіпотеза. Вона має описувати не лише зміни, а й очікуваний ефект. Наприклад: «Якщо змінити колір іконки з синього на помаранчевий, CTR сторінки збільшиться на 10% завдяки кращій помітності у видачі».

Головне правило — тестуємо один елемент за раз. Якщо одночасно змінити іконку, скриншоти та опис, ми ніколи не зрозуміємо, що саме вплинуло на результат. Рухаємося крок за кроком — від найважливішого до другорядного.

Урахування зовнішніх факторів також важливе. Період тесту має включати будні та вихідні, щоб уникнути викривлень через зміну поведінки користувачів. Не запускаємо тести під час великих свят або рекламних кампаній, що можуть штучно змінити трафік.

Правильно спланований тест — це вже половина успіху. Він дозволяє отримати не просто дані, а actionable insights для подальшого розвитку.

Процес A/B-тестування в Google Play

У Google Play Console доступний потужний інструмент — Store Listing Experiments, що стає справжньою лабораторією для дослідження вподобань аудиторії. Ми можемо тестувати практично всі елементи сторінки: скриншоти, відео, описи та графіку. Єдине важливе обмеження — назви додатків не можна тестувати через цей інструмент, для цього потрібне повноцінне оновлення.

Щоб розпочати тестування, потрібно зайти в Google Play Console, вибрати додаток і знайти розділ "Growth" / "Store listing experiments". Саме тут створюються всі A/B-тести:

- експеримент із графічними об’єктами за замовчуванням

Цей тип експерименту використовують для тестування графічних елементів, що показуються певній частині відвідувачів сторінки.

- експеримент з локалізованою версією

Такий тест дозволяє перевіряти графіку та описи серед користувачів, які переглядають сторінку певною мовою. Спершу додаємо переклади необхідних мов, після чого можемо запускати до п’яти паралельних локалізованих експериментів.

- експеримент із цінами

Експерименти з цінами дозволяють перевіряти та точніше коригувати вартість товарів відповідно до купівельної спроможності різних ринків. Установлюючи окремі ціни для кожної країни, можна залучати користувачів із різним бюджетом.

Система дозволяє одночасно запускати до трьох варіантів сторінки, що особливо корисно при роботі з локалізаціями. Тест зазвичай триває 7–14 днів, але формально Google Play не встановлює мінімальної тривалості — тест завершується після досягнення статистичної значущості.

Головна перевага — чіткі, вимірювані результати того, який контент справді резонує з аудиторією. Система автоматично розподіляє трафік та показує рівень статистичної значущості, допомагаючи ухвалювати обґрунтовані рішення щодо покращення сторінки.

Процес A/B-тестування в App Store

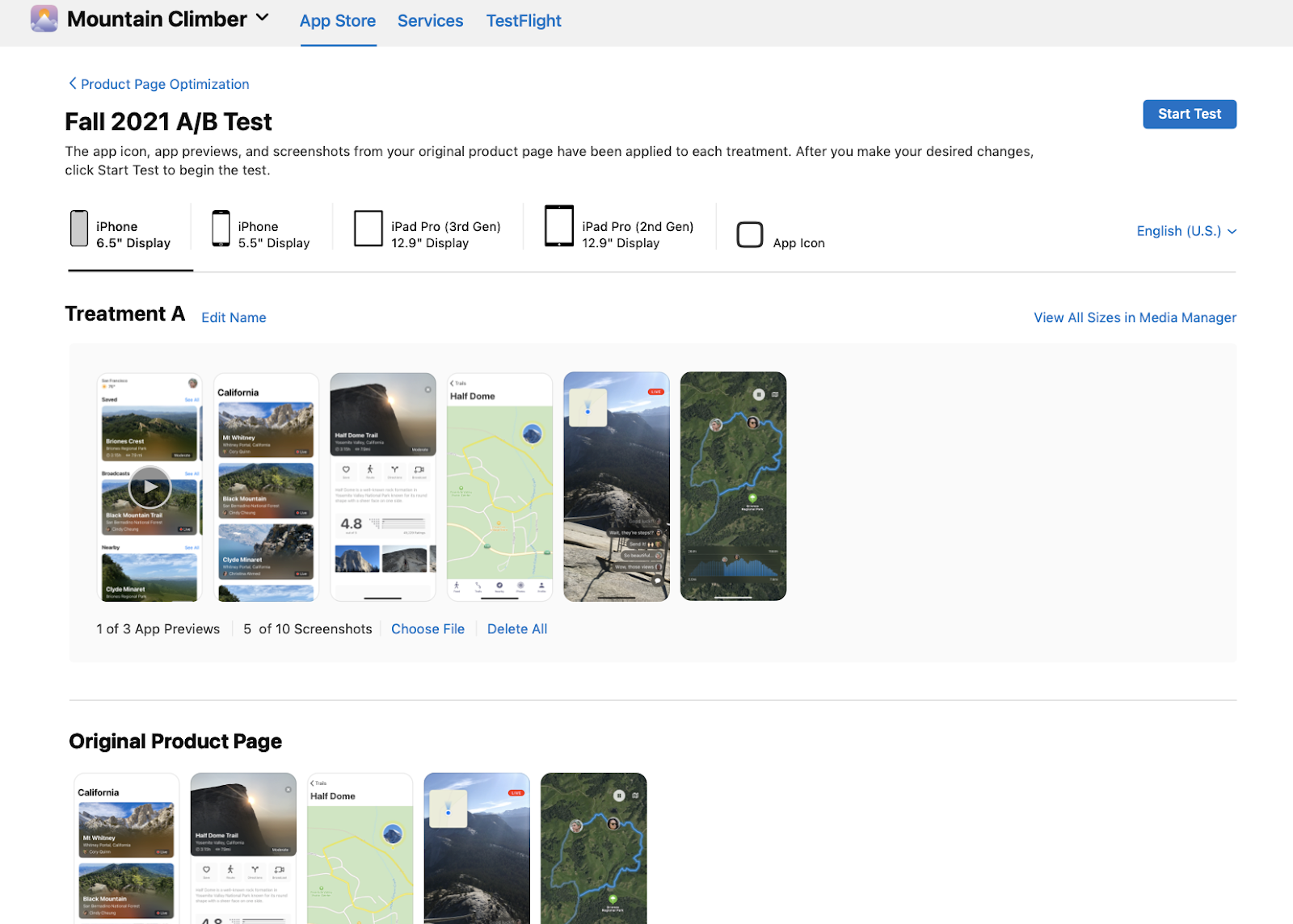

У App Store Connect для оптимізації сторінки доступний інструмент Product Page Optimization (PPO). Щоб почати, потрібно перейти в App Store Connect, вибрати додаток і перейти до розділу "Features" / "Product Page Optimization".

Особливість Apple — обов’язковий рев’ю кожного варіанта сторінки, що триває 2–3 дні. Ми можемо тестувати до трьох альтернативних варіантів одночасно з оригіналом, що дозволяє порівнювати різні підходи до подачі контенту.

Період тестування може тривати до 90 днів, що достатньо навіть при невеликому трафіку. Однак важливо враховувати мовні обмеження — тест налаштовується окремо для кожної локалізації.

Після запуску система автоматично розподіляє користувачів між варіантами та надає детальну аналітику по конверсії. Це дозволяє точно визначити, який дизайн і контент найкраще працюють у App Store, перш ніж застосовувати зміни до всієї сторінки.

| Елементи A/B-тесту | App Store | Google Play |

| Назва додатка | Ні | Ні |

Іконка | Так | Так |

| Скриншоти | Так | Так |

| Відеопрев’ю | Так | Так |

| Підзаголовок | Ні | — |

| Короткий опис | — | Так |

| Повний опис | Ні | Так |

| Кількість варіацій | До 3 | До 3 |

| Аудиторія | Випадковий сегмент органічних користувачів | Випадковий сегмент усіх відвідувачів сторінки |

| Тривалість тесту | До 90 днів | Рекомендовано мінімум 7 днів |

| Проходить рев’ю | Так | Так |

| Локалізація | Так | Так |

Аналіз та інтерпретація результатів

Коли тест завершується, починається найважливіший етап — аналіз даних. Статистично значущий результат (зазвичай 95% і вище) означає, що різниця між варіантами не випадкова, і ми можемо довіряти висновкам.

Головні метрики:

- Конверсія — скільки користувачів встановили додаток після перегляду сторінки

- CTR — скільки людей перейшли на сторінку із пошукової видачі

- Утримання — як довго користувач залишається після встановлення

Навіть «невдалі» варіанти можуть бути цінними. Якщо варіант Б показав нижчу конверсію, але краще утримання — це означає, що він привертає меншу, але якіснішу аудиторію. Кожен результат доповнює портрет нашого користувача.

Після завершення тесту ми:

- Впроваджуємо переможний варіант

- Фіксуємо гіпотезу та результати у базі знань

- Формуємо нові гіпотези для наступних тестів

A/B-тестування — це циклічний процес: тест, аналіз, впровадження, новий тест. Він перетворює ASO-стратегію на систему постійного вдосконалення та наближає наш додаток до ідеального відповідності очікуванням користувачів.

Основні помилки під час A/B-тестів

Навіть добре продуманий тест може виявитися марним, якщо припуститися типових помилок. Ці пастки чекають як новачків, так і досвідчених фахівців, а їх ціна — втрачений час і хибні висновки.

- Передчасне завершення A/B-тесту — поширена помилка. Важливо розуміти, що фіксований період тестування (наприклад, 7–14 днів) сам по собі не гарантує коректних результатів. Головне — статистична значущість і достатній обсяг вибірки. Якщо трафіку багато, якісні результати можна отримати вже за кілька днів. Якщо вибірка мала — і два тижні не допоможуть. Тому орієнтуватися потрібно не на час, а на показники значущості та стабільність даних.

- Дисбаланс трафіку між варіантами спотворює результати. Якщо один варіант отримує більше користувачів у певний час, чистота експерименту порушується.

- Зовнішні втручання — запуск тесту під час великих кампаній або свят дає дані, які не відображають реальної ефективності змін.

- Перенесення результатів між платформами — припущення, що працює в App Store, може не спрацювати в Google Play, оскільки аудиторії різні.

Уникаючи цих помилок, ми отримуємо чисті та надійні дані для ухвалення важливих рішень.

Практичні поради та інструменти

Щоб тести приносили максимальну користь, важливо правильно визначати пріоритети. Матриця «вплив/затрати» допомагає зосередитися на найважливішому. У правий верхній сектор потрапляють тести з найбільшим потенціалом зростання та найменшими зусиллями — наприклад, зміна першого скриншота або кольору іконки. Саме з них варто починати.

Чекліст підготовки A/B-тесту:

- Сформульовано чітку гіпотезу та метрику успіху

- Вибрано лише один елемент для тестування

- Перевірено вимоги платформи (App Store / Google Play)

- Налаштовано рівномірний розподіл трафіку

- Ураховано будні та вихідні

- Виключено періоди свят і рекламних кампаній

- Визначено мінімальний термін тесту

- Підготовлено систему фіксації результатів

Автоматизація аналізу через Firebase та інші системи економить години ручної роботи. Вони допомагають побачити закономірності, наприклад, як зміни на сторінці впливають на довгострокове утримання.

Візуальна локалізація — це не просто переклад. Кольори, символи, жести — усе сприймається по-різному в різних культурах. Те, що працює в Європі, може не підійти Азії. Тестування різних підходів дозволяє створити персоналізований досвід.

З часом ці практики стають природною частиною процесу, дозволяючи проводити тести швидше, а отримані результати — робити точнішими.

Висновок

A/B-тестування — це не разова акція, а постійний діалог з аудиторією. Сторінка нашого додатка повинна розвиватися та адаптуватися до змін у поведінці користувачів.

Його головна цінність — у можливості послідовних покращень. Кожен тест стає фундаментом для наступного, створюючи кумулятивний ефект, що з часом дає вражаючі результати.

Не менш важливо документувати всі експерименти — від початкової гіпотези до підсумкових висновків. Ця база знань — наш корпоративний спадок, що допомагає новим членам команди уникати помилок і розуміти логіку прийнятих рішень.

Ми не просто слідуємо трендам — ми створюємо дані, що допомагають ухвалювати зважені рішення і впевнено рухатися вперед у конкуренції за увагу користувачів.

Тестуйте та досягайте успіху 💙

A/B-тестування — це спосіб порівняти різні версії сторінки застосунку, щоб зрозуміти, який варіант краще сприймається користувачами та дає вищу конверсію. Воно допомагає ухвалювати рішення на основі даних, а не припущень.

Насамперед варто тестувати те, що формує перше враження: іконку, перші скриншоти, відеопрев’ю та короткий опис. Саме ці елементи найбільше впливають на рішення користувача встановити застосунок.

Зазвичай тест завершується тільки після досягнення статистичної значущості. Це гарантує, що результати є надійними та не залежать від випадкових коливань трафіку.

В App Store кожен варіант обов’язково проходить рев’ю, а тест може тривати до 90 днів. У Google Play тести запускаються швидше, не потребують рев’ю і дозволяють перевіряти більше елементів, включно з текстами та цінами.